1. Sigmoid

特点

✅ 输出范围 (0,1) 适合概率预测

❌ 梯度消失问题

❌ 计算成本较高

2. ReLU (Rectified Linear Unit)

特点

✅ 计算高效

✅ 缓解梯度消失

❌ 可能出现神经元死亡

python

import torch

x = torch.arange(-8.0, 8.0, 0.1, requires_grad=True)

y = torch.relu(x)python

import tensorflow as tf

x = tf.Variable(tf.range(-8.0, 8.0, 0.1), dtype=tf.float32)

y = tf.nn.relu(x)3. Tanh

特点

✅ 输出中心对称

✅ 比 Sigmoid 梯度更强

❌ 仍存在梯度消失

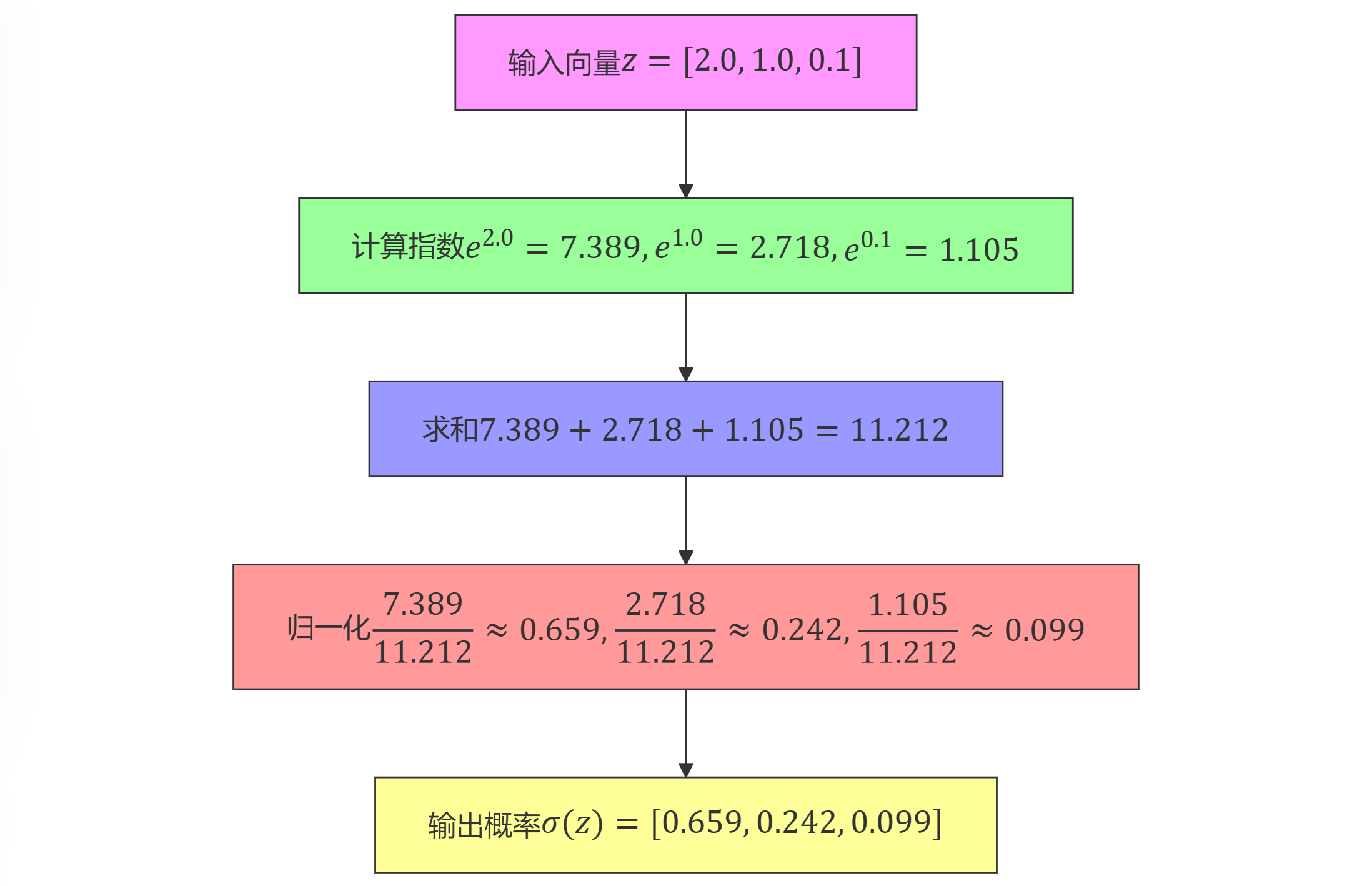

4. Softmax

特点

✅ 输出概率分布

✅ 适合多分类问题

❌ 对极端值敏感

5. Argmax

该函数返回使函数

特点

✅ 直接选择最大值,忽略其他值的贡献

❌ 不可导

6. Softargmax

特点

✅ 通过概率分布加权所有值,保留其他值的贡献

✅ 可通过梯度下降优化